Relatório inédito da Polícia Nacional revela que a maioria das vítimas são estudantes e os agressores, muitas vezes, são colegas da mesma instituição.

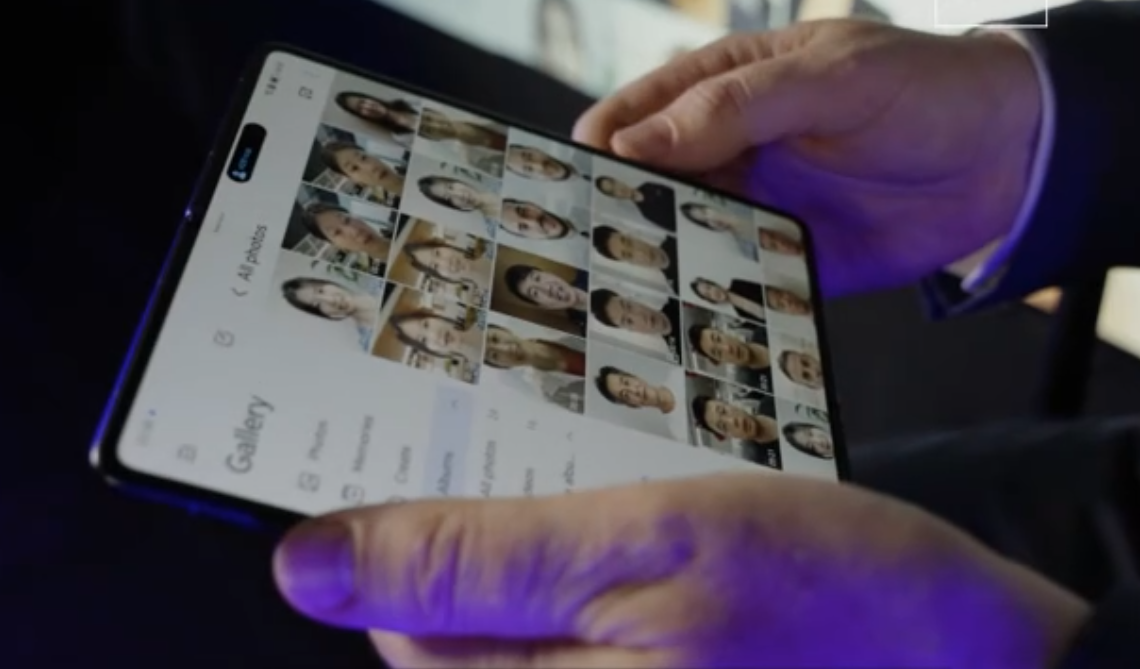

A Agência Nacional de Polícia (NPA) do Japão divulgou seu primeiro relatório detalhado sobre o avanço de deepfakes pornográficos entre jovens. Os dados revelam um cenário alarmante: ferramentas de Inteligência Artificial generativa estão sendo usadas para transformar fotos comuns de colegas de classe em imagens sexualmente explícitas.

Nos primeiros nove meses de 2025, a polícia registrou 79 casos de vítimas com menos de 20 anos. Em mais da metade dessas ocorrências, o criador do conteúdo era um estudante da mesma escola que a vítima.

Perfil das Vítimas e Métodos de Agressão

O relatório aponta que a prática atinge estudantes de diversos níveis escolares, com foco principal no ensino secundário.

- Distribuição das Vítimas (Jan-Set 2025):

- Ensino Fundamental II (Junior High): Mais de 50%.

- Ensino Médio (High School): Mais de 30%.

- Ensino Fundamental I (Elementary): 4 casos registrados.

- Ferramentas Utilizadas: Os criminosos utilizam principalmente ferramentas de IA generativa e aplicativos de edição de imagem para “desnudar” fotos reais.

- Fontes das Imagens: As fotos são frequentemente retiradas de redes sociais ou até de álbuns escolares digitais acessíveis por tablets fornecidos pelas escolas.

Casos Reais e Ações Policiais

A polícia japonesa tem intensificado a resposta criminal e educativa diante da gravidade dos episódios:

- Venda de Imagens: Em um dos casos, um estudante do ensino fundamental II usou IA para alterar a foto de uma colega e vendeu a imagem para outro aluno.

- Abuso de Confiança: Um assistente de ensino utilizou fotos de um álbum de graduação de sua escola para criar conteúdos falsos.

- Terceirização do Crime: Em novembro, a polícia de Kyoto encaminhou aos promotores um estudante de Tochigi que pediu a um desconhecido na internet para “sexualizar” a foto de uma colega usando IA.

- Estatísticas de Punição: No ano passado, de 110 casos totais, sete resultaram em ações criminais por difamação e 38 receberam avisos formais da polícia.

Prevenção e Canais de Ajuda

A NPA, em conjunto com outros órgãos governamentais, lançou uma campanha educativa com o título direto: “A maneira como você usa a IA pode ser ilegal”. O objetivo é conscientizar jovens de que criar ou compartilhar deepfakes não é uma “brincadeira”, mas um crime com consequências severas.

O governo japonês disponibilizou canais específicos para suporte:

- Linha Direta para Vítimas de Crimes Sexuais: No Japão disque #8103.

- Centros de Consulta Infantil: Acionados em casos que envolvem menores de idade para orientação juvenil.

| Categoria | Dado Estatístico |

| Total de Vítimas (<20 anos) | 79 (até setembro) |

| Principal Local de Origem | Mesma escola da vítima |

| Principais Alvos | Alunos do Ensino Fundamental II |

| Crime Tipificado | Difamação e Exibição Pública de Conteúdo Obsceno |

Com informações via Asahi Shimbun